## 一、前言 前两天在哪个新闻上看到有人做了一个OPC,然后招了一些名人来帮他打工,挺美的,那篇文章一下子找不到了。 这个周末在家,我也给我的[小落同学](https://www.oddmeta.net/project-xl “小落同学”)招了几个员工,分别是 Musk, Jobs, Linus, Turing, Carnegie, Zezos,分别负责和担任小落同学的CEO,UCX,Developer, Test, Marketing, Support。 今天找了半天,想找之前看到的文章,并借鉴一下他的具体方案,但死活就是没找到,于是就先自己硬着头毛先实现一个版本试试。 这个月没有买token plan,然后前两天白嫖的小米MiMo大模型的token也过期了,所以我又回到了open code。 实现后,我让这些员工一起协同给小落同学设计了一个 `中文字符unicode转换的工具`,并跑通了整个流程。下面是整个流程全记录。 ## 二、思路及Spec探索 一些客套、扯蛋、吹牛的废话就省略了,直接上整个流程。 ### 1、思路探索 在opencode里打开小落同学的代码目录,输入提示词 #### INPUT:提出我的计划 “`bash 我在小落同学数据库中新增了几个角色,Musk, Jobs, Linus, Turing, Carnegie, Bezos等,希望让他们成为生产力工具,我跟Musk交待任务(MVP产品开发任务),然后Musk让Jobs设计,Linus开发, Turing测试, Carnegie市场销售推广,Bezos技术支持。 在现有的代码基础上设计一套agent框架流程,来实现这些角色的串联。 “` #### OUTPUT: 协作方式 “`bash 从项目探索来看,当前架构是单角色单轮对话模式,还没有任何多Agent编排能力。 我的第一个问题是理解交互流程: 你希望的协作方式是哪种? A. 全自动编排 — 你给Musk下达任务后,Musk自动拆解、依次分派给Jobs→Linus→Turing→Carnegie→Bezos,每个Agent的输出自动传递给下一个,最终返回完整结果给你 […]

## 一、前言 之前聊了三篇了。Embedding 搜索、Reranker 精排、向量索引加速。文本侧的 RAG 管线基本捋顺了。但有读者问了一个现阶段我还没法回答的问题:**小落同学能不能听懂人话?** 不是 NLP 层面的”理解”,是物理意义上的。你对着手机说一句话,它翻译成另一种语言,再读出来。实时的那种。 小落同学目前跑在一台十年前的笔记本和一台 99 块的 ECS 上,2GB 内存,纯 CPU。这个硬件跑 Whisper 语音识别?想都不用想。但手机就不一样了——现在的 Android 手机,哪怕是个中端机,也塞了 8GB 内存和一堆 NPU/DSP 加速单元。 RTranslator 就是干这个的。开源的,离线的,实时的,一个 Android 翻译 App。翻译用 Meta 的 NLLB,语音识别用 OpenAI 的 Whisper。全在手机上跑,不联网,没服务器。 RTranslator 在 GitHub 上 10k+ stars 了,v2.1.5 已经发了,v3.0 还在搞。这篇就是想看看它能不能帮小落同学实现同声传译——能不能把手机变成小落同学的耳朵和嘴巴。 ## 二、方案介绍 先把概念拉出来: | 概念 […]

一、前言 半个多月前,计划着给我的小落同学做个改版,当时的目标是在一张消费级3060的GPU上跑全套虚拟人ASR+TTS+3DAvatar。 当时是计划着搞一台电脑,再去买一张3060的GPU,然后在上面跑全套的KWS+ASR+TTS+3DAvatar,但是后来想想现在去买3060实在有点过时,而如果要买新的50系列的卡呢又实在太贵,犹豫了几天后啥也没买,然后五一假期就到了。 于是,没办法,我只能继续在我这台10年前的老笔记本上折腾。于是,整个五一我就门也没出,一个人在家折腾这个东西了。于是,经过几天的折腾,现在终于有一个基础版本了。 市面上各种虚拟人方案多如牛毛,但是基本上清一色都需要GPU,咱买不起带GPU的电脑,所以自己手搓了这么一个方案。 简单汇总一下小落同学的优点如下: 百度网盘下载地址:https://pan.baidu.com/s/1y7ifkopK5ZesSgPUqxTY5A?pwd=vifz 提取码: vifz 二、先看效果 不废话,先直接看效果。简单录了两个视频, 一个是纯文本交互模式的, 另一个是全语音交互模式。 1. 在99元/年的2H2G阿里云ECS上跑产品知识问答(文本交互) https://www.bilibili.com/video/BV1htRvBWEfM 2. 十年前老笔记本(无GPU)上可跑全套语音交互,稍卡 https://www.bilibili.com/video/BV1xfReBVEQr 三、下载安装 1. 从github代码仓库下载 仓库地址:https://github.com/oddmeta/yay 克隆代码 安装依赖 运行服务 2. Windows绿色免安装包 无需安装python环境,无法安装依赖包/下载安装模型等繁杂的操作,解压缩后即可直接运行,使用的是硅基流动的免费API。私信:MetaYAY,即可获取。 四、进阶玩法 1. 完全本地运行(可断网运行) 若要完全本地运行,需自行下载ollama,并下载模型,然后修改根目录下的环境变量配置文件.env,将模型切换为本地的ollama,然后关闭运行中的metayay,再双击start.bat重新运行。 自行搜索教程。 根据你自己的硬件配置,下载不同尺寸的模型,具体什么模型适合你的硬件,可以把自己的硬件输入进去,问一下千问、豆包、Deepseek。 打开.env文件,将下面的三个变量设置成下面这样: LLM模型: Embedding模型: 注:若有多个设置,最终实际生效的是最下面的一个。 若已有启动YAY,先关闭,然后再双击 start.bat 重新启动。 浏览器打开:http://localhost:8000 ,测试验证。 2. 更新你自己的知识库 1)偷懒的办法 直接修改现有角色的知识库。 (1) 修改角色信息 […]

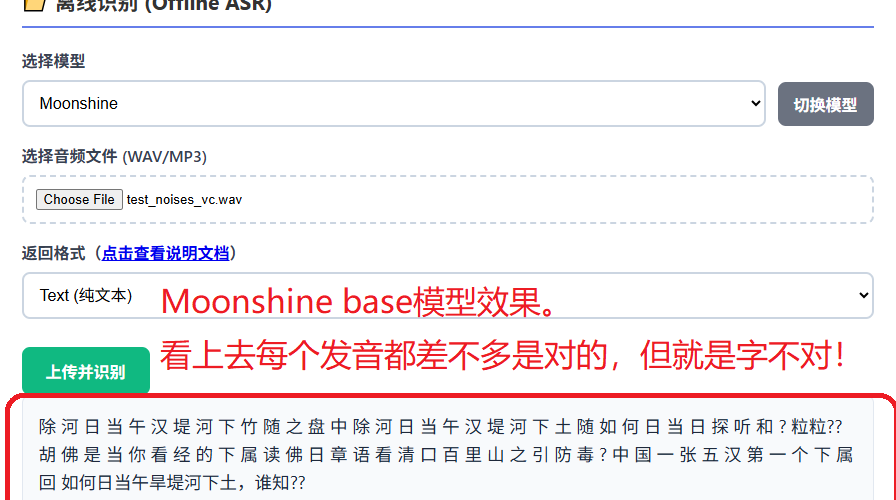

前两天研究了一下Moonshine Voice,当时拿了几个简单的音频文件测试了一下,感觉效果还可以,所以我就开始将其整合到了OddASR项目里。 但是在完成了整合后,再进行测试的时候发现一些比较严重的问题,所以,我又赶紧把我刚刚上传到pypi的OddASR给撤了,然后重新将主力模型改回到paraformer-zh-streaming和paraformer-zh。 当前OddAsr最新版本:v2.1.0,已恢复paraformer模型。 以下是在OddAsr自带的测试界面上分别跑paraformer-zh和moonshine base模型的效果 测试音频 具体的声音情况可以看这个视频: https://mp.weixin.qq.com/s/y4l-YtaUhayV9k9EDatCzw 注:这个视频中并未使用我的OddASR,效果差不是我OddAsr项目的锅。相反,下面我后来有将这个视频中的音频提取出来,专门作为OddAsr的一个测试集,每次测试不同的ASR模型的时候都会来测试一下这种场景。比如:这次的Moonshine base中文模型的测试。 测试效果 测试使用的音频就是上面那个视频里提取出来的音频。 paraformer模型效果 只想用一个字来形容:bravo! moonshine base模型效果 看上去转写出来的每个发音都是对的,但是。。。。这些个字呢。。。。好像就没几个是对的。 总结 唉,如果不是因为我这个用了超过十年的老笔记本CPU不太够用,我也完全不想去折腾一些其他的轻量级的ASR模型。

前言 最近在折腾 OddTTS 项目,涉及语音合成后的处理。发现一个很香的轻量级变声方案——直接用 FFmpeg 就能搞定,不需要复杂的模型部署。 本文记录 FFmpeg 变声的核心方法、性能数据、以及在 OddTTS 项目中的实际应用场景。 先来听听效果 原始声音: 变声: 卡通声: 一、FFmpeg 变声原理解析 1.1 核心滤镜:asetrate + aresample FFmpeg 变声的核心在于两个滤镜的配合: 简单理解:asetrate 相当于把录音速度改了,音调随之变化;aresample 把时长”拉”回来。 1.2 保持原始时长:atempo 上面的方法会导致音频时长变化。如果要保持原时长,需要加 atempo: 原理:asetrate 改变音调会改变时长,atempo 反向调整速度,两者抵消。 二、常用变声效果库 直接套用,无需记公式: 效果 命令 适用场景 男变女 asetrate=44100*1.4,aresample=44100 客服配音 女变男 asetrate=44100*0.7,aresample=44100 角色切换 卡通音 asetrate=44100*2,atempo=0.5,aresample=44100 短视频特效 机器人声 afftfilt=real='hypot(re,im)*0.3':imag='0' 科幻配音 […]

前言 我从去年开始就一直在零零碎碎的自己搞一个小落同学的项目,我的目标是: 给自己做一个专属的虚拟人,把 TA 当作我自己的树洞。每天或者隔一段时间,把想说的话、想吐槽的事都告诉 TA。等哪天想咨询点什么事的时候,去问 TA,看看 TA 记住的东西多了之后,会不会比我自己还了解我。 然后今天看到一个Pika的项目,于是就去研究、学习了一下。 一、它是什么? 当大多数 AI 厂商还在忙着卷工具的时候,Pika 突然发了条推:算了,不卷了,我们来”造人”。 2026 年 2 月,Pika 出了个叫 AI Selves 的产品。官方说法是:一个由你”孕育,培养并放手”的 AI 分身,成为你的一个活生生的延伸。 说人话就是:不是那种只会答题的聊天机器人,而是一个有记忆、会学你说话风格、能同时在好几个平台帮你跑业务的数字分身。 消息一出,科技媒体全在转。腾讯、网易、搜狐的标题都差不多——”不卷视频卷造人”。国外更热闹,评价两极分化,有人说是 AI 的下一个未来,也有人直接管这叫”AI 奴隶制”。 我看到的时候愣了一秒:这不就是我正在搞的”小落同学”吗? 今天来扒一扒这东西,顺便对比一下我的项目。 二、怎么用? 第一步:加入候补 现在还没全量开放,得先去官网排队: 官网入口:https://pika.me 支持 Google 账号和邮箱登录。邮箱注册可能要收个验证码,也可能直接进候补名单等通知。 第二步:设置你的分身 点 “Birth Your AI Self” 开始创建。 这一步决定你的分身有多像你: 官方原话:”一切由你决定。” 第三步:定外观 三个选项: […]

一、先看效果 你有一本 10 万字的技术电子书,想把它变成有声书。不是那种机器感很强的合成音,而是自然流畅的人声。 把文本拖进去,点一下开始,然后去喝杯咖啡。回来的时候,一本完整的有声书已经躺在你的文件夹里了。 这不是科幻,这是我真做出来的功能。 实测效果: 二、什么是 OddTTS? OddTTS 是我之前开源的语音合成 API 封装项目。 两个特点:多引擎、低成本。 多引擎:支持 Kokoro、MeloTTS、Edge TTS、OpenAI TTS 统一调用。 低成本:Kokoro 可以在十年前的老笔记本上跑,纯 CPU 推理,一次部署无限使用。 以前做有声书,要么买云端 API(一本书几十块),要么自己部署大模型(需要显卡)。 现在一台几百块的 CPU 机器就能跑,还免费。 三、用 oh-my-openagent 实现的全流程 这一节讲讲我怎么做这个项目。 3.1 第一步:需求分析 用的 Agent:Metis(预规划分析) 直接跟 oh-my-openagent 说”我想做一个有声书功能”,它会调用 Metis 帮你分析: Metis 分析的结果: 3.2 第二步:制定计划 用的 Agent:Prometheus(任务规划) Prometheus 会制定详细的实现计划: Prometheus […]

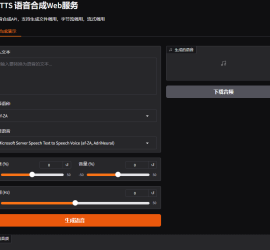

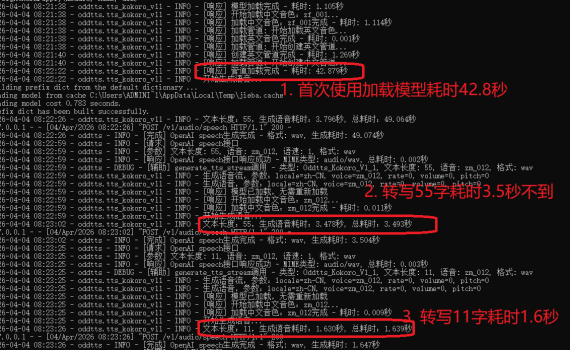

上个星期分别测试了一下两个轻量级的语音合成模型,分别是: 其中Kokoro以更低的CPU要求,可完美达成我的小落同学项目的实时语音交互的需求,因此现在我已经将我的小落同学的主打语音合成在OddTTS上切到了kokoro v1.1。 这里要特别感谢一下一位大佬:路遥。因为前面我以为Kokoro不支持中英混合,所以一开始是准备用MeloTTS的(对CPU要求相对较高),在他的提示下才发现原来Kokoro也可以通过将创建英文和中文两个pipeline来实现中英混合。 以下是一些相关的介绍。 一. 安装 OddTTS 二. 启动 OddTTS 在命令行中输入下面的命令即可启动: 启动后,浏览器打开地址:http://127.0.0.1:9001 启动后,浏览器打开地址:http://your_ip_addr:8080 注: Linux/MacOS: 三. 使用 OddTTS OddTTS支持自定义协议的API,也支持OpenAI兼容接口的API,一般用户建议用OpenAI兼容接口来使用,三行代码搞定语音合成。 其他的API接口可以看OddTTS项目的API接口说明。 四、一些测试数据 1. 合成的语音的效果 合成的语音的效果可以看我之前的测试文章: 正常语速wav格式正常语速mp3格式3倍语速mp3格式 2. 合成的速度 这个是在我的这台十年前的老笔记本上跑的数据: 注:这个3.5秒可认为是首字时延,后面由于合成的速度比播放的速度要快得多的多,所以在长文(需切句子)合成的情况下,实际体验的时延可以做到趋近到500ms以内。 具体如下图所示。 3. 切换不同的TTS模型/引擎 OddTTS有集成了多种不同的TTS模型,包括: OddTTS提供了一个简单的管理、测试界面,在启动了OddTTS后可以在浏览器里打开oddtts,然后动态切换TTS模型/引擎。 五、注意事项 模型下载问题 Kokoro的模型放在huggingface.co上,在国内访问存在问题,解决方案: set HF_ENDPOINT=https://hf-mirror.comset HF_HOME=F:/ai_share/models export HF_ENDPOINT=https://hf-mirror.comexport HF_HOME=/opt/ai_share/models 输出wav正常,输出MP3报错 OddTTS的依赖里有加了ffmpeg,但是如果你机器上原先就有安装过ffmpeg有可能会报错,若是报错了,请再手动安装一下ffmpeg即可。 服务启动失败 语音合成失败 如何切换TTS引擎 输出格式 […]

一、前言 你有没有想过,让电脑帮你念一段文章?或者给家里的智能设备添加语音播报功能? 很多人第一次接触语音合成(TTS),想到的是讯飞、百度这些云端API。但仔细一算:调用一次要花钱、网不好会卡顿、隐私数据还要传出去——这对于普通用户来说,门槛实在太高了。 更现实的需求是这样的: 这些场景共同的特点是:设备性能有限、没有显卡、最好能离线使用、还要省钱。 这就是轻量级TTS的用武之地。 二、轻量级TTS方案对比 说方案、对比方案前,先用我实测的一些音频大家听一下效果,感受一下MeloTTS的实际效果。 中英混合:欢迎关注我的公众号:奥德元。一起学习AI,一起追赶时代。Good good study, day day up. 英文-美国口音: text to read 英文-澳大利亚口音: text to read 2.1 主流轻量级TTS方案一览 方案 参数量 部署要求 中文支持 开源协议 特点 MeloTTS ~300M CPU实时 ✅ 优秀 MIT 多语言、多口音、推理快 espeak-ng – 超低资源 一般 GPL 体积超小(4MB),音质机械 Flite – 低资源 ❌ C 轻量但效果一般 VITS […]

一、前言 前两天针对轻量级TTS引擎Kokoro做了一些测试( https://mp.weixin.qq.com/s/xKBLfAkfImwHrjYIml0KuA ),测试下来发现效果居然挺好的,而且自带8种音色的支持,纯CPU跑,速度还快,测完了我就停不下来了,当时就想把它整合到我的OddTTS项目,今天周末终于有空,于是就简单搞了一下,现在已经在我的小落同学上用上了。 二、主要更新 先看效果 正常语速wav格式 正常语速mp3格式 更新内容 三、如何使用 1. 安装 pip install -i https://pypi.org/simple/ oddtts 2. 启动 oddtts 启动后,浏览器打开地址:http://127.0.0.1:9001 若要允许其他IP访问,请使用以下命令启动服务,将host设置为0.0.0.0,端口也可以改成你自定义的端口。 启动后,浏览器打开地址:http://your_ip_addr:8080 3. API调用示例 以下是一个OddTTS的API调用的示例,建议用OpenAI 兼容接口 四、注意事项 模型下载问题 Kokoro的模型放在huggingface.co上,在国内访问存在问题,解决方案: set HF_ENDPOINT=https://hf-mirror.comset HF_HOME=F:/ai_share/models export HF_ENDPOINT=https://hf-mirror.comexport HF_HOME=/opt/ai_share/models 输出wav正常,输出MP3报错 OddTTS的依赖里有加了ffmpeg,但是如果你机器上原先就有安装过ffmpeg有可能会报错,若是报错了,请再手动安装一下ffmpeg即可。 服务启动失败 语音合成失败 如何切换TTS引擎 输出格式 环境要求