前言

最近在折腾 OddTTS 项目,涉及语音合成后的处理。发现一个很香的轻量级变声方案——直接用 FFmpeg 就能搞定,不需要复杂的模型部署。

本文记录 FFmpeg 变声的核心方法、性能数据、以及在 OddTTS 项目中的实际应用场景。

先来听听效果

原始声音:

变声:

卡通声:

一、FFmpeg 变声原理解析

1.1 核心滤镜:asetrate + aresample

FFmpeg 变声的核心在于两个滤镜的配合:

# 基础变调:升调 20%

ffmpeg -i input.mp3 -af "asetrate=44100*1.2,aresample=44100" output.mp3- asetrate:改变采样率,直接影响音调高低

- aresample:重采样到原始频率,保持音长不变

简单理解:asetrate 相当于把录音速度改了,音调随之变化;aresample 把时长”拉”回来。

1.2 保持原始时长:atempo

上面的方法会导致音频时长变化。如果要保持原时长,需要加 atempo:

# 升调 1 octave(2倍)+ 保持时长

ffmpeg -i input.mp3 -af "asetrate=44100*2,atempo=0.5,aresample=44100" output.mp3

# 降调 1 octave(0.5倍)+ 保持时长

ffmpeg -i input.mp3 -af "asetrate=44100*0.5,atempo=2,aresample=44100" output.mp3原理:asetrate 改变音调会改变时长,atempo 反向调整速度,两者抵消。

二、常用变声效果库

直接套用,无需记公式:

| 效果 | 命令 | 适用场景 |

|---|---|---|

| 男变女 | asetrate=44100*1.4,aresample=44100 |

客服配音 |

| 女变男 | asetrate=44100*0.7,aresample=44100 |

角色切换 |

| 卡通音 | asetrate=44100*2,atempo=0.5,aresample=44100 |

短视频特效 |

| 机器人声 | afftfilt=real='hypot(re,im)*0.3':imag='0' |

科幻配音 |

| 低沉声 | asetrate=44100*0.7,aresample=44100,aecho=0.8:0.9:1000:0.5 |

旁白配音 |

变调系数速查

| 系数 | 效果 |

|---|---|

| 1.4 | 男声→女声 |

| 1.2 | 略升高 |

| 0.8 | 略降低 |

| 0.7 | 女声→男声 |

| 2.0 | 卡通/ Chipmunk |

三、高质量方案:Rubberband 插件

如果对音质有更高要求,推荐使用 Rubberband 插件。

3.1 安装

# Ubuntu/Debian

sudo apt install rubberband-utils

# macOS

brew install rubberband3.2 使用方法

# 升调 2 semitone

ffmpeg -i input.mp3 -af "rubberband=pitch=2.0" output.mp3

# 降调 1 semitone + 加速 2倍

ffmpeg -i input.mp3 -af "rubberband=pitch=0.943874:tempo=2" output.mp3pitch 参数计算:2^(semitones/12)

- 升1 semitone: 2^(1/12) ≈ 1.059463

- 降1 semitone: 2^(-1/12) ≈ 0.943874

3.3 两种引擎选择

| 引擎 | 特点 | 适用场景 |

|---|---|---|

| R2 | 快速,默认 | 实时变声、预览 |

| R3 | 高质量,CPU高2-3倍 | 后处理、最终输出 |

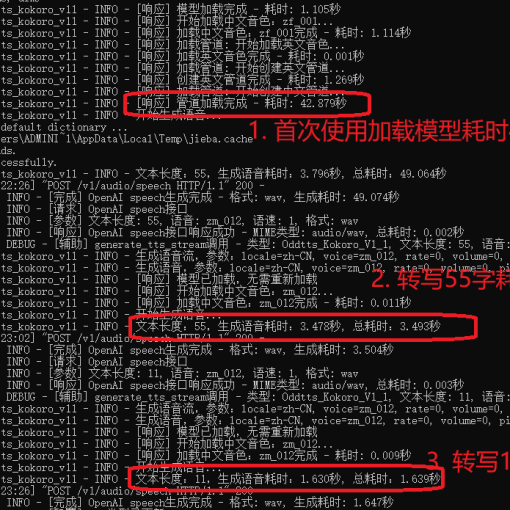

四、性能数据与实测

这是大家最关心的部分。

4.1 处理速度

| 方法 | 1分钟音频耗时 | 10分钟音频耗时 |

|---|---|---|

| 基础变调(asetrate) | 3-5秒 | 约10秒 |

| 复合变调(atempo+asetrate) | 5-8秒 | 约15秒 |

| Rubberband R3 | 15-20秒 | 约30秒 |

结论:FFmpeg 变声基本是实时或超实时的,比模型推理快得多。

4.2 CPU 性能参考

| CPU | 处理速度 | 备注 |

|---|---|---|

| i9-14900K | ~80 FPS | 顶级 |

| i7-14700K | ~70 FPS | 高端 |

| i5-14600K | ~56 FPS | 主流 |

| AMD Ryzen 7 780X3D | ~62 FPS | 游戏神U |

注:音频处理比视频编码快得多,上述是视频编码测试的参考值。

4.3 批量处理优化

需要处理大量音频?用 GNU Parallel:

# 8核并行处理

find ./input -name "*.mp3" | parallel -j 8 'ffmpeg -i {} -af asetrate=44100*1.2,aresample=44100 -c:a libmp3lame -b:a 192k {.}.output.mp3'实测效果:500个WAV文件,12.7分钟 → 1.5分钟(7.3倍加速)

五、在 OddTTS 项目中的应用

5.1 场景一:TTS 后处理变声

OddTTS 生成语音后,根据角色需求调整音色:

import subprocess

def voice_change(input_file, output_file, pitch_factor=1.2):

cmd = f'ffmpeg -y -i {input_file} -af asetrate=44100*{pitch_factor},aresample=44100 -c:a libmp3lame {output_file}'

subprocess.run(cmd, shell=True)5.2 场景二:Voice Clone 预处理

GPT-SoVITS 等模型对输入音频格式有要求,用 FFmpeg 预处理:

# 调整采样率、声道

ffmpeg -i clone_source.wav -ar 24000 -ac 1 -c:a pcm_s16l clone_adjusted.wav5.3 场景三:多语言音色匹配

中文 TTS 转不同语言风格:

# 英文风格化

ffmpeg -i chinese_tts.mp3 -af "asetrate=44100*1.1,aresample=44100" english_style.mp3六、注意事项与局限

6.1 atempo 限制

- 范围:0.5 – 100

- 超过2倍需要链多个 atempo:

ffmpeg -i input.mp4 -af "asetrate=44100*4,atempo=1/2,atempo=1/2" output.mp46.2 音质损耗

- 基础变调有轻微失真,可接受

- 高要求场景用 Rubberband R3

- 多次级联会累积失真

6.3 与专业模型的区别

| 方案 | 优点 | 缺点 |

|---|---|---|

| FFmpeg 变声 | 轻量、即时、无需GPU | 只能是简单变调 |

| GPT-SoVITS | 可克隆音色 | 需要训练素材 |

| ElevenLabs | 质量高 | 付费、云端 |

七、总结

FFmpeg 变声是一个被低估的轻量级方案:

- 够快:1分钟音频3-5秒搞定

- 够简单:一行命令,不需要模型

- 够用:适合客服配音、角色切换、旁白等场景

- 免费:开源方案,无成本

如果是 OddTTS 这类 TTS 项目,FFmpeg 变声可以作为后处理的首选方案。简单需求用基础变调,高质量需求用 Rubberband。

相关资源

- FFmpeg 官方文档:https://ffmpeg.org/ffmpeg-filters.html

- Rubberband 库:https://breakfastquay.com/rubberband/

- OddTTS 项目:https://github.com/oddmeta/oddtts

广而告之

关注公众号:奥德元

一起学习AI,一起追赶时代!

新建了一个AI技术交流群,欢迎大家一起加入讨论。

若需联系作者,请加微信:oddmeta